Vorteile

Nachteile

Deepfakes werden missbraucht, um nicht-einvernehmliche explizite Inhalte zu erstellen. Davon betroffen sind unter anderem bekannte Persönlichkeiten wie Taylor Swift und Xochitl Gomez – aber auch jede Person, die Fotos online teilt.

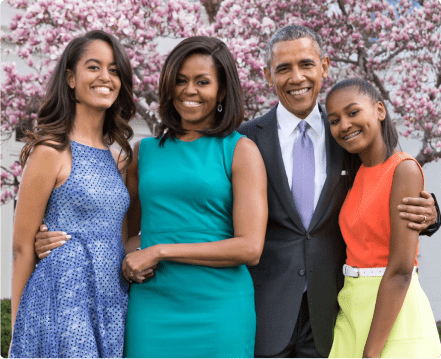

Beunruhigende Beispiele sind Deepfakes von Joe Biden oder dem slowakischen Politiker Michal Šimečka, die eingesetzt wurden, um Wahlergebnisse zu beeinflussen.

Ein bekanntes Beispiel ist „Fast & Furious 7", in dem der Schauspieler Paul Walker mithilfe von Deepfake-Technologie zu sehen war – obwohl er 2013 während der Dreharbeiten verstarb.

Deepfake-Algorithmen erwecken historische Persönlichkeiten zum Leben und machen Vorträge und Präsentationen oft fesselnder als traditionelle Unterrichtsmethoden oder Schulbücher.

Mit KI-generierten Modellen lassen sich Produkte wie Kleidung digital präsentieren – ganz ohne aufwändige Fotoshootings. Auch virtuelle Einkaufserlebnisse werden dadurch möglich.